今年第一の記事は、評価用のRB2011UiAS-RMを株式会社シー アイオープラスさんから貸していただいた(ありがとうございます!)ので、一部界隈でアツいRouterBoardについてファーストインプレッションと簡単なベンチマークをしてみました。

本来だと先先週の初めくらいには評価を終わらせようと思っていたのですが風邪引いたり忙しかったり現場が

外観について

まずは全面。しかし肝心の全体像の写真を撮り損ねていたので製品イメージ画像です。まだ手元にありますが撮りなおすのがめんd(ry

インターフェース構成は、5GiE+1SFP+5FEと言う構成です。これらのインターフェースはルーティングインターフェースにもスイッチインターフェースにもなります。6つの1GibEというのは中々強そうです。

また、Port1がPoE受電、Port10がPoE給電ポートになってはいるのですが、入力電圧が30Vで48Vのaf準拠ではないので一般的なスイッチにつないでも何も起きません。ここは対応してほしかったところではあります。

そして裏面。裏面にはシスコきしめんのシリアルポートがあります。ACポートは、10-28Vの入力に対応し、口さえ合えば大体のACアダプタが使えます。最初からついてきたのは24V0.5Aだったので、大体12W前後あればよさそうな感じがします。

奥行きです。横に長いものの、奥行きはものすごく短く、大体SSDと同じくらいの大きさでした。

LCDを前面ではなく上面に配置し、より小型化したRB2011UAS-INというモデルがあるので、自分のように19インチラックを持っていない場合はこちらの方が設置には融通が利くかもしれません。

電源を入れたところです。電源確認の青色LEDが思いの外輝度高いです。某DCの某ルーターで状態確認用青色LEDに養生テープが貼ってあったのを思い出します。丁度ネットワークラックの目の高さに置いてあったので、作業中にLEDの光が目に刺さって痛かったのでしょう。

そんなことはどうでもよく、1Uサイズでラックマウントキットもついているので家で使うことはあんまり考えられていない気がしますが、人によっては寝床に置くには明るすぎるというかもしれません。その際には養生マスクがおすすめです。常時足元燈にはいいかもしれません。ちなみにファンレスです。

次に、LCDです。このルーターにはLCDが搭載されていて、感圧式なもののタッチパネルなので、ぽちぽちとここから色々いじれます。

PINの認証をすると、タッチパネルからシステムインターフェースのIPの設定も出来ます。あくまで簡易的なものなので、ここからVLANの設定などは出来ません。ちなみに初期PINは1234です。

実用的なのは、このスループットグラフです。タッチすることによりppsとbpsを切り替えられます。この画面から抜けるには下から上にフリックする必要があるのですが、前述の通り感圧式なのでフリック系の作業は指の腹ではつらい時があります。ですが、物珍しくて面白いです。

それ以外にも、Uptime、温度、入力電圧などの情報を一定間隔で切り替えるInfomationSlideshowというものもあります。

機能について

まだ全ての機能を検証した訳ではないので、さわりだけ紹介します。

RBを操作する方法として、WebFigというWebGUIを使う方法と、Winboxと言う専用アプリケーションを使う方法があります。どちらも操作できる内容としては同じなのですが、Winboxの方はIPでアクセスできなくてもシステム用ブリッジに繋がっていればMACアドレスを元にログインできるので、IPを変更したあと繋がらなくなってしまった場合につかえます。

それらを使いインターフェースを設定していきます。インターフェースの種類は、物理インターフェースの他に、以下のようにVLAN、Bonding、GRE、EoIP、OpenVPN…など、大体のトンネルは制覇してそうな感じに種類があります。

物理インターフェースは、デフォルトではeth1だけが別扱いで、それ以外はbridge-localというブリッジに繋がっていてL2として動きます。

デフォルトのFWは以下のようになっています。

NATのセクションでは以下のような設定が入っていて、デフォルトではeth1がWANインターフェースとして動いていて、内側の通信はマスカレードされて外に出て行きます。

機能についてはまだまださわれていませんが、ぱっと見こんな感じです。

みんな大好きiperf

とりあえず、素の状態でiperfしてどの程度でるか、と言うのが気になるので、特にチューニングせずiperfしていきます。

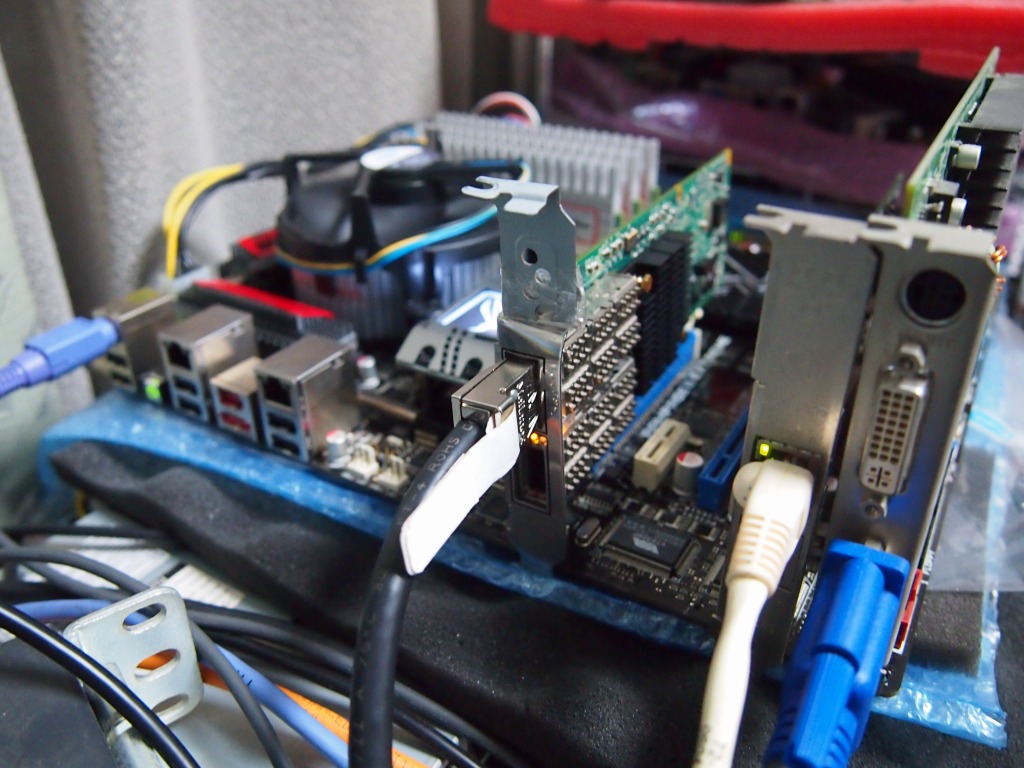

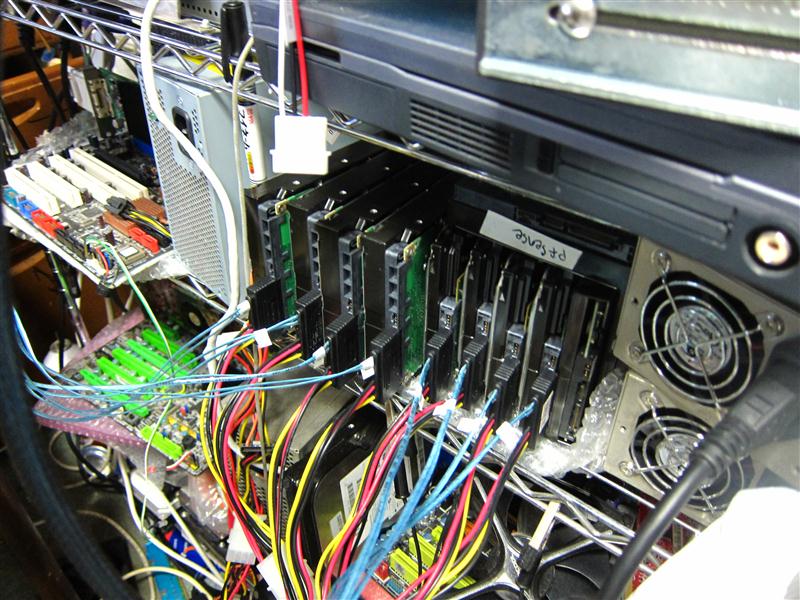

今回はいつもの構成ではなく、以下のように一つの物理マシンをESXi5.5を入れ、VMを内部で2台動かし、ポート1とポート2でそれぞれのvSwitchを作成し、VM1とVM2の通信をこのポートを使って通信するように設定してます。ほんとは別件でVMサーバとして使おうと思いつつ放置していたサーバなのですが、ついでなので使いました。

RBとサーバの間に挟まってる何かは今回全く使っていないので無視してください。

HW構成

M/B : Supermicro X9SCL-F

CPU : Xeon E3-1225 V2

Mem : ECC UDIMM 4x4GB 1333MHz

NIC : Intel 1000PT/QuadPort

OS : VMware ESXi 5.5

テスト環境OS

割り当てCPU 2CPU

割り当てMem 2GB

OS Debian 7.2/x86-64

NIC : vmxnet3

1を作成後、vCenterServerよりクローンを行い2を作成したため、全く同じ構成のVMです。また、VMにはvmware-toolsが入っています。

まずは、ループバックを作りiperfを行い、vmwareのカーネルの限界がまだ来ていないことを確認します。

どうでも良いですが、かしめ器が有るとつい限界まで短いケーブル作ってしまいますよね。作ったあと、短すぎて自分でも何に使うか分からなかったのですが今回役に立ちました。

以下のコマンドを実行した結果です。そのまま貼ると長くなるので結果だけ貼ります。

for a in {1,2,4,8,16,32,64,128} ; do iperf -c IP -i 1 -w ${a}K >>iperf_direct.txt ; done

上からTCP Window sizeを1K、2K,4K、8K、16K、32K、64K、128Kと変化させました。

[ 3] 0.0-10.1 sec 159 MBytes 133 Mbits/sec

[ 3] 0.0-10.0 sec 624 MBytes 523 Mbits/sec

[ 3] 0.0-10.0 sec 566 MBytes 474 Mbits/sec

[ 3] 0.0-10.0 sec 794 MBytes 666 Mbits/sec

[ 3] 0.0-10.0 sec 996 MBytes 835 Mbits/sec

[ 3] 0.0-10.0 sec 1.09 GBytes 939 Mbits/sec

[ 3] 0.0-10.0 sec 1.10 GBytes 941 Mbits/sec

[ 3] 0.0-10.0 sec 1.10 GBytes 941 Mbits/sec

物理マシン同士で実行してもこの程度なので、ハイパーバイザがネックになることはまだないと思われます。また、結果は1秒おきに出力しましたが大きなブレはありませんでした。

この値を元に、ケーブルをRBのポート2と3に繋ぎ、同じようにiperfしてみました。

[ 3] 0.0-10.0 sec 153 MBytes 128 Mbits/sec

[ 3] 0.0-10.0 sec 520 MBytes 435 Mbits/sec

[ 3] 0.0-10.0 sec 556 MBytes 466 Mbits/sec

[ 3] 0.0-10.0 sec 738 MBytes 619 Mbits/sec

[ 3] 0.0-10.0 sec 844 MBytes 707 Mbits/sec

[ 3] 0.0-10.0 sec 1.02 GBytes 879 Mbits/sec

[ 3] 0.0-10.0 sec 1.06 GBytes 910 Mbits/sec

[ 3] 0.0-10.0 sec 1.06 GBytes 908 Mbits/sec

若干の劣化はありますが、許容の範囲内だと思います。また、通信があるとLCDのインターフェース選択部分にも反映されます。

このように、見てて面白いです。某店の某サービス提供時に配布される某所のOEMの某ラグビー型の某WLAN APもLCDついているならYoutube再生機能とか言う訳の分からないゴミクズバグ機能をつけないでこっちをつけた方が数百倍役に立ったのではと思います。

この写真を撮る途中に切れないように10分間iperfを流しましたが、フリーズや再起動などはありませんでした。

さて、ブリッジ同士での通信が取れたので、今度はWAN側に当たるIPマスカレード先の物理マシンにiperfしてみます。物理マシンとはL2通信時にはほぼループ時と同じ値がでていることを確認しています。

その結果、以下のようになりました。

[ 4] 0.0-10.1 sec 33.1 MBytes 27.6 Mbits/sec

[ 5] 0.0-10.0 sec 272 MBytes 228 Mbits/sec

[ 4] 0.0-10.0 sec 295 MBytes 247 Mbits/sec

[ 5] 0.0-10.0 sec 299 MBytes 251 Mbits/sec

[ 4] 0.0-10.0 sec 303 MBytes 254 Mbits/sec

[ 5] 0.0-10.0 sec 307 MBytes 257 Mbits/sec

[ 4] 0.0-10.0 sec 296 MBytes 248 Mbits/sec

[ 5] 0.0-10.0 sec 297 MBytes 249 Mbits/sec

んー?これは…少し性能劣化が気になるところです。NATさせると性能が落ちる、というのはどっかの銀色のルーターを思い出しますね。それよりは数十倍早いですが。

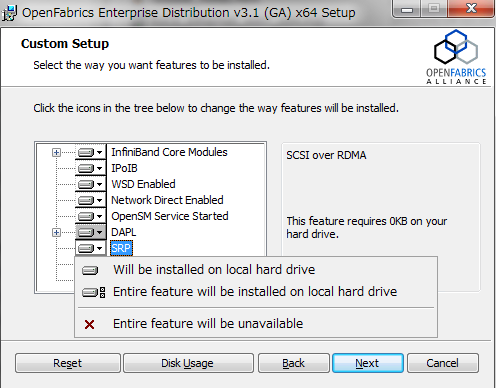

こちらではRoutingでも最低は698Mbpsは出るような気がしていたのですが、それには及びません。そこで、FastPathとは何か、発動条件は何か、と調べてみると、以下のような制限があることに気がつきました。

http://wiki.mikrotik.com/wiki/Manual:Fast_Path

IPv4 fast path is automatically used if following conditions are met:

firewal rules are not configured,

Traffic flow is disabled /ip traffic-flow enabled=no

Simple and queue trees with parent=global are not configured.

source interface is not bridge port or bonding slave

destination interface queue is set to only-hw-queue and no queue tree entries with parent="dst interface"

no mesh, metarouter interface configuration,

sniffer, torch and traffic generator is not running

connection tracking is not active

ip accounting is disabled (/ip accounting enabled=no);

VRFs are not set (/ip route vrf is empty);

Hotspot is not used (/ip hostspot has no interfaces);

IpSec policies are not configured (ROS v6.8)

要するに、CPUがパケットを見ずに、チップ上でスイッチできる必要があると言う事みたいです。しかしfirewal rules are not configuredという制限はちょっと辛い…。。

試しに、Fastpathが有効になるかどうか、全てのFWルールを削除し、ローカルブリッジからeth2とeth3を外し、単純なIPルーティングのみをさせてみました。

Port2が192.168.87.1/24で、Port3が192.168.86.1/24で、それぞれを独立インターフェースとして動かし、それぞれの仮想マシンのでふぉげを変更したルーターのIPにしました。

[ 3] 0.0-10.1 sec 49.9 MBytes 41.5 Mbits/sec

[ 3] 0.0-10.0 sec 648 MBytes 543 Mbits/sec

[ 3] 0.0-10.0 sec 755 MBytes 633 Mbits/sec

[ 3] 0.0-10.0 sec 789 MBytes 662 Mbits/sec

[ 3] 0.0-10.0 sec 889 MBytes 746 Mbits/sec

[ 3] 0.0-10.0 sec 1.01 GBytes 864 Mbits/sec

[ 3] 0.0-10.0 sec 1.04 GBytes 889 Mbits/sec

[ 3] 0.0-10.0 sec 1.03 GBytes 889 Mbits/sec

確かに、速度は戻りました。色々見てみると、やはりNATを有効にするとブリッジポートではないRoutingPort間の通信は300Mbps前後に落ち込んでしまうようです。

このテストをした後、RB勉強会があったので中の人に聞いてみたところ、「CPUでの処理はお察しください。そういった方は32コアのCCR1036-8G-2S+EM をどうぞ」と言われたので、やはりそういう物みたいです。

とはいうものの、新品実売価格1万後半のルーターでここまで遊べるルーターを見たことないので、ネットワークGeekにはとてもおすすめです。全然深いところを触れていませんが、GUIを触った感じで「ああこれは遊べるな」と思えます。

まだまだ機能にさわれていないので、もっと遊んできたいと思います。誰か時間ください。]]>